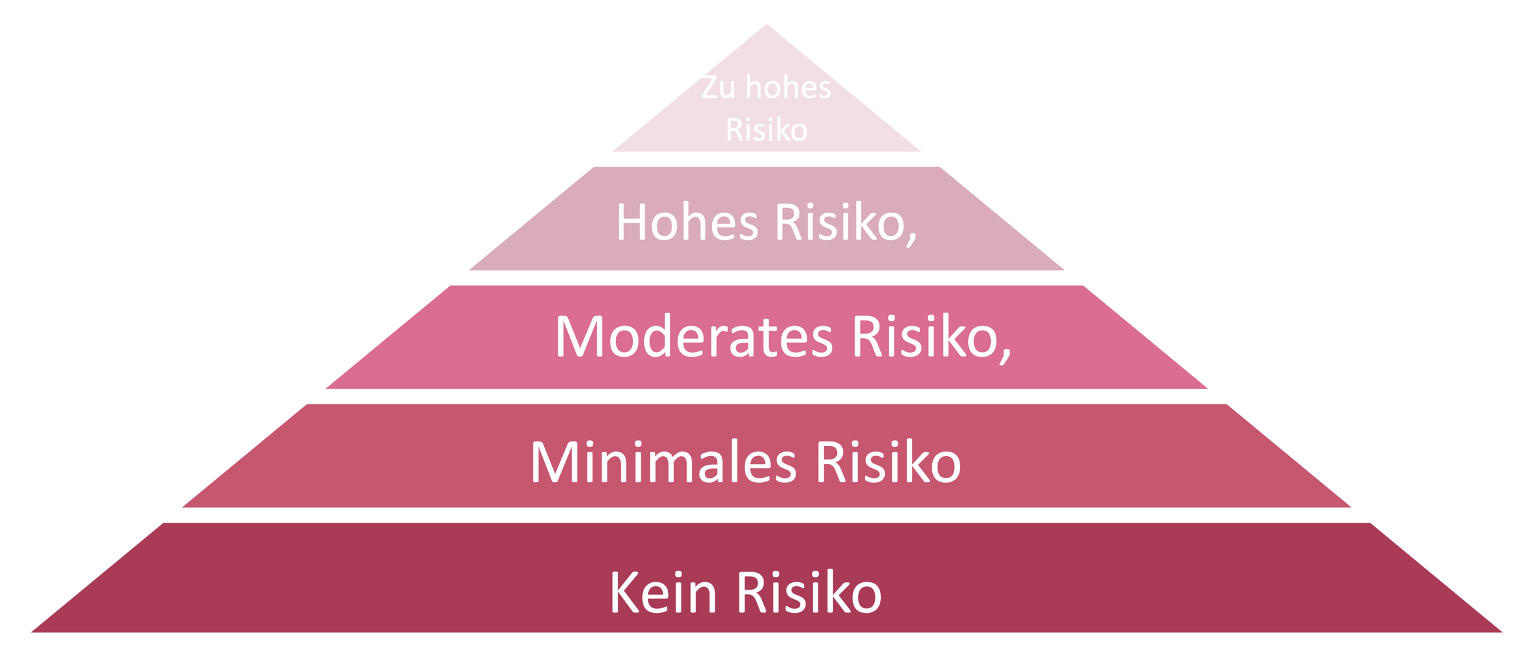

KI-Risikoklassen – Erläuterung und Einordnung?

In welcher Risikoklasse man unterwegs ist, richtet sich nicht danach, wer man ist oder als was man arbeitet, sondern welche KI zum Einsatz kommt.

Setze ich ChatGPT zum Erstellen von Dokumenten ein, handelt es sich um eine KI mit minimalem Risiko, wofür nur wenige Regelungen in der KI-Verordnung existieren. Ganz risikofrei ist die Anwendung nämlich in den Augen der Gesetzgebung nicht. Es handelt sich um sogenannte General Purpose AI (GPAI), die zumindest ein begrenztes, systemisches Risiko mit sich bringt.

Was dagegen eine Hochrisiko-KI oder sogar eine verbotene Praktik ist, bestimmt sich nach der Anwendung. Möchte ich eine KI einsetzen, die Bewerbungen analysiert und mir Vorschläge macht, wen ich einstellen soll und wen nicht, sind wir schon im Hochrisikobereich.

Wenn ich darüber hinaus sogar die hausinterne Videoüberwachung so einstelle, dass eine KI mit per Gesichtserkennung sagt, welche Mitarbeitenden sich gerade wo aufhalten, habe ich eine verbotene Praktik.

Aufschluss gibt hier die KI-Verordnung, die in Art. 5 die verbotenen Praktiken aufzählt und in Art. 6 auf die Anhänge II und III verweist, in welchen genau aufgelistet ist, welche Anwendungen in den Hochrisikobereich fallen. Fällt die von mir benutze oder gewünschte Anwendung nicht in diese beiden Bereiche, habe ich nur mit den weniger anspruchsvollen Risikoklassen zu tun.

Es kann also sein, dass in einem Unternehmen, die Anforderungen mehrerer Risikoklassen umgesetzt werden müssen.